Угрозы внедрения технологий искусственного интеллекта (2023)

Капитан 1 ранга Н. Башкиров,

кандидат военных наук, профессор АВН

Внедрение новых технологий, в том числе искусственного интеллекта (ИИ), окажет решающее влияние на архитектуру глобальных угроз безопасности существования и выживания человечества в условиях ослабления на Западе морально-нравственных устоев1. Значительное число публикаций на эту тему посвящено опасности неконтролируемого развития и неэтичного использования информационно-коммуникационных технологий2, в особенности технологий искусственного интеллекта (ТИИ).

По мнению ведущих зарубежных экспертов, это в перспективе может привести к новому балансу сил в мире, геополитической и геоэкономической неопределенности, а также фундаментальной трансформации социального мышления3. Несмотря на то что развитие искусственного интеллекта находится на уровне так называемого специализированного, ориентированного на решение лишь определенного узкого круга задач, эксперты выделяют ряд связанных с этим угроз в политической, экономической, социальной, нормативно-правовой и военной сферах.

Это обусловлено возможным использованием ТИИ в качестве:

– оружия массового влияния на сознание человека в глобальном масштабе;

– катализатора нового миропорядка (международных отношений);

– базиса роботизации экономики с коренной трансформацией сферы занятости;

– основы создания гибридных человеко-машинных систем;

– инструмента биотехнологий (синтетической биологии);

– фундамента для внедрения идей технофашизма в обществе;

– средства совершения киберпреступлений и реализации кибертерроризма;

– фактора, определяющего трансформацию характера военных конфликтов.

Большинство таких угроз сложно отнести к какой-либо одной из сфер (политической, экономической, социальной, военной и др.), поскольку они носят комплексный и многоплановый характер.

В частности, ТИИ представляют опасность для развития социально-политической системы, поскольку предполагают возможность решения сложных социальных проблем на основе подавления свободы воли и контроля сознания людей4. По сути такие технологии становятся оружием массового влияния, инструментом проведения информационных операций с возможностью трансграничного воздействия на объекты глобального информационного пространства.

Превосходство в области развития и внедрения в практику жизнедеятельности человека инновационных технологий ИИ трансформируется в международный режим управления цифровыми ресурсами. На смену традиционным войнам приходят новые цифровые технологии власти, массового социального контроля и управления, манипулирования поведением населения большинства стран мира. ТИИ становятся эффективным инструментом обеспечения интересов ведущих держав (транснациональных структур)5 в плане управления мировым информационным пространством на основе цифровизации всех сфер жизнедеятельности и тотального контроля личности. Становится возможным целенаправленный сбор данных в отношении общества в целом как для манипулирования общественным мнением, оказания всякого рода давления, угроз, шантажа и принуждения, так и подрыва доверия ("демонизации") к властным структурам. При этом транснациональные элиты добиваются полной потери государствами "цифрового суверенитета" и легального присутствия на их внутреннем рынке иностранных компаний – владельцев таких технологий с целью формирования поведенческих моделей и идеологических мировоззрений населения.

О важности технологий ИИ как инструмента информационной войны свидетельствует тот факт, что в США планируется разработка "Национальной стратегии действий в глобальном информационном пространстве" (National Strategy for the Global Information Domain) в качестве дополнения к "Стратегии национальной безопасности США". В 2022 году комиссия Соединенных Штатов по вопросам обеспечения национальной безопасности в сфере технологий ИИ дала рекомендации создать Межведомственную оперативную группу (Joint Interagency Task Force) и Центр информационных операций.

Предполагается, что последний будет оснащен необходимыми средствами информационного противоборства на основе ТИИ как для осуществления внутренней цензуры, так и ведения подрывных информационных операций за рубежом. Предусматривается также формирование международного центра "по борьбе с дезинформацией"6 под руководством госсекретаря США.

Следует отметить, что внедрение технологий ИИ привело к возникновению технологий "цифровой тени" ("цифрового двойника"). Поэтому в качестве угрозы необходимо рассматривать создание цифровых метавселенных в качестве альтернативы традиционному мироустройству с массовым привлечением в свои ряды граждан суверенных государств7 (своего рода виртуальная колонизация мира). Уже на современном этапе бюджеты существующих виртуальных государств превышают 3 трлн долларов со своими пользователями численностью более 2 млрд человек. Прогнозируется, что в обозримом будущем объем валового продукта, созданный такими метавселенными, будет превосходить объем глобального ВВП. В результате нарастает опасность перехвата власти у реальных политических субъектов в пользу виртуальных.

Следует отметить отсутствие международного и государственного нормативно-правового регулирования ТИИ как чрезвычайно эффективного инструмента геополитического и экономического влияния в глобальном цифровом пространстве.

Технологии ИИ выступают также средством, способствующим усилению межцивилизационных, межгосударственных, культурных и других противоречий, и в конечном счете – катализатором нового миропорядка (международных отношений). Технологическое превосходство и раньше давало возможность Западу диктовать свою волю менее развитым странам. Сейчас же появляется опасность кардинального углубления неравенства и увеличения разрыва в развитии богатого "глобального Севера" и бедного "глобального Юга" с ускорением процессов (созданием предпосылок) дальнейшей глобализации мира.

Складывающаяся ситуация может спровоцировать разрушение существующей в мире системы товарно-хозяйственных связей и стать предвестником формирования относительно автономных технологических экосистем.

Эти процессы можно характеризовать как "ИИ-неоколониализм" с участием стран-лидеров и стран-аутсайдеров. Последние становятся поставщиками "больших данных" (Big Data) для стран-колонизаторов как самого ценного ресурса XXI века в обмен на помощь для поддержания зачастую полунищенского существования населения колоний. По мнению американских и китайских специалистов, всем странам мира за исключением двух лидеров в этой сфере (США и КНР8) уготована участь ИИ-колоний.

Сейчас борьба за глобальный цифровой рынок находится в стадии активной подготовки.

Роботизация экономики приведет к коренной трансформации сферы занятости и переформатированию всего социального пространства через реорганизацию основных бизнес-процессов. В цифровые формы современной экономики постепенно войдут алгоритмы общественных отношений, в том числе трудовых. Реальностью может стать получение ограниченным числом лиц неограниченного контроля над материальным производством и сокращение значительного числа рабочих мест за счет автоматизации и роботизации. В конечном счете произойдет организационно-технологическое переформатирование сферы занятости с разрушительными социальными последствиями. В связи с этим эксперты в ближайшей перспективе не исключают появление следующих процессов:

– массовые высвобождения на рынке труда (под угрозой исчезновения наиболее массовые профессии с дальнейшей эрозией индустриальной экономики);

– утрата качественных характеристик человеческого капитала и как следствие: дефицит рабочих мест в высокотехнологичной экономике; переток образованных работников в низкоквалифицрованные сегменты занятости;

рост числа невостребованных профессий быстрее сроков получения профессионального образования; целенаправленное разрушение традиционной системы образования; невозможность содержания дорогостоящей образовательной инфраструктуры в условиях сокращения потребности в массовых профессиях;

– экономия на социальных издержках при глобальном разделении труда (социальные последствия "цифровых трансформаций" не входят в число приоритетов государственного риск-менеджмента);

– падение уровня жизни населения (сокращение доходов, покупательной способности и уровня социальных гарантий).

Кроме того, ожидается сокращение деятельности следующих сфер: услуги (упаковка, складирование, такси, курьеры и пр.); обслуживание глобальной экономики (финансовая сфера, маркетинг, реклама, логистика и др.); и процессов цифровизации (data-, call-, service-центры и т. п.).

В настоящее время ведутся масштабные исследования в области создания гибридных человеко-машинных систем, то есть установления прямой связи информационных систем, глобальных информационных сетей с деятельностью мозга человека9 посредством применения инвазивных и неинвазивных наноустройств. Это приведет к очередному перевороту в информационной сфере и поставит вопрос об автономии индивида, его свободе и защите от всеобъемлющего контроля со стороны государства и корпораций.

Опасность заключается в возможности проведения различных экспериментов над человеческим организмом10 якобы для усиления способностей человека в интеллектуальной сфере, а на самом деле – для подавления свободы воли и контроля сознания. В случае создания интерфейса "мозг – ЭВМ" возникают проблемы в сфере этических правил взаимодействия человека с искусственным интеллектом.

Технологии ИИ превращаются в инструмент биотехнологий (синтетической биологии). Неконтролируемое развитие биоинформатики и генной инженерии по своим разрушительным последствиям может превзойти ущерб от применения ядерного оружия. Особым направлением является синтетическая биология, которая позволяет производить новые виды бактерий и живых организмов с использованием специальных растворов и программных кодов, транслируемых компьютером в питательную среду. Компьютерное исследование генома открывает необозримые возможности для генной инженерии и принципиально новых видов медицины11. Эта угроза резко возрастает, уже сейчас достижения в биоинформатике позволяют создавать кибербиооружие направленного действия, то есть поражать группы людей с определенными генетическими маркерами.

Достижения биотехнологии (синтетической биологии) на основе ТИИ и высокопроизводительных вычислительных систем (включая средства редактирования генома) повышают опасность создания: высокотоксичных патогенов избирательного воздействия на определенные лица, этнические и расовые группы и пр.; потенциала для ведения избирательной и высокоэффективной биологической войны на основе доступа к медицинским базам данных о состоянии здоровья населения; хранилищ и сбора генетических данных о населении12, флоре и фауне (сельскохозяйственных культурах и животноводстве) государств-противников.

В социально-правовой сфере идея придания искусственному интеллекту субъектности, попытки наделить роботов правами как "квазисубъектов общества" может привести к появлению технофашизма.

Попытки решения философско-этических вопросов о будущей роли и взаимоотношений человека и роботов в современных социально-экономических условиях являются далеко не простыми. Стремление обеспечить надежное, безопасное развитие и использование технологий ИИ с учетом человеческих ценностей входит в противоречие с целями "транснациональной элиты" (транснациональных корпораций и банков), занимающей господствующие позиции в основных международных институтах и правительственных органах ведущих государств мира. Эти цели заключаются в "роботизации сознания" человека и низведении его до уровня робота13.

Идеологическими основами подобного подхода к ТИИ выступают:

– вульгарный материализм или элиминативный физикализм (elimination – устранение), нигилистическое отрицание духовной стороны жизни; когда феномен сознания невозможно объяснить, то делается вывод о его отсутствии;

– редукционизм (методологический принцип, согласно которому сложные явления могут быть полностью объяснены с помощью законов, свойственных явлениям более простым) высшей духовной сферы человека до уровня "рацио";

– монизм – тело и душа выражают одну сущность (идеальное и материальное совпадают, проистекая из одной сущности);

– функционализм – сведение мысли к материальному процессу, который в сущности есть некий функционал (в итоге мысль и мышление – это функциональные взаимоотношения нейронов);

– бихевиоризм – человеческое поведение сводится только к реакциям организма на внешние воздействия;

– научный и технологический детерминизм – отрицание свободы воли, утверждение о неспособности человека выйти за рамки предопределенности (алгоритма);

– трансгуманизм – отрицание свободы воли, автоэволюция человека (эволюция, которая протекает не по природным законам, а направляется самим объектом эволюции);

– неолиберализм – десуверенизация и упразднение института государства, превращение его в корпорацию с передачей функций на транснациональный уровень.

Серьезную актуальность приобрела проблема распространения киберпреступности и кибертерроризма, многократно усиленная появлением трансграничных террористических группировок и опасностью выведения из строя объектов критически важной инфраструктуры. Необходимо подчеркнуть, что подрывные действия в киберпространстве в настоящее время невозможно квалифицировать как агрессию, так как разработка технологий ИИ не охватывается существующими международно-правовыми нормами.

Сюда же следует отнести опасность распространения интеллектуальных автономных средств поражения и их применения транснациональными и террористическими преступными группами.

Технологии ИИ окажут трансформирующее влияние на характер войны во всех сферах противоборства – от подводной среды до киберпространства и всего электромагнитного спектра. Непосредственно в военной сфере следует отметить следующие угрозы использования ТИИ:

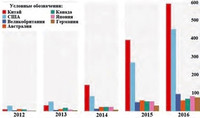

– дестабилизация международной обстановки в результате развязывания гонки вооружений на базе технологий ИИ с интеграцией ресурсов государства и частных компаний (авторитарно-демократический ИИ-капитализм) между странами-лидерами. Еще в 2018 году пять стран (США, Китай, Индия, Великобритания и Франция)14 объявили о разработке национальных военных программ на основе таких технологий;

– возрастание военной опасности как следствие нарушения военно-стратегического баланса (достижения одностороннего преимущества в соотношении сил) в мире в результате информатизации и роботизации вооруженной борьбы на основе ТИИ15. Другими словами, потеря лидерства или значительное отставание от передовых государств в области ТИИ ведет к значительной утрате национальной безопасности и суверенитета;

– опасность инициирования (эскалации) военных конфликтов вследствие ошибок в интеллектуальных системах принятия решений и действий автономных средств поражения, а также при масштабном использовании искусственного интеллекта во всех сферах противоборства.

Этому способствует рост степени автоматизации (интеллектуализации) систем принятия решений на основе ТИИ, обусловленный повышением скорости обработки информации и управления войсками и оружием, что практически исключает действие человеческого фактора. В итоге происходит усиление зависимости человека от функционирования весьма сложных автономных систем и неконтролируемого взаимодействия между ними;

– перспектива организации развитыми промышленными сверхдержавами или транснациональными структурами так называемых чистых войн (clean wars) против стран "третьего мира" с использованием робототехнических комплексов военного назначения (РТК ВН) при отсутствии или минимуме потерь личного состава;

– опасность дегуманизации конфликтов вследствие применения технологий ИИ при отсутствии каких-либо международных соглашений и актов относительно контроля над военным применением таких технологий (в первую очередь РТК ВН);

– использование ведущими державами мира технологий ИИ в сочетании с когнитивными, био- и нанотехнологиями для реализации стратегии гибридных войн и управляемого хаоса в интересах переноса центра тяжести вооруженной борьбы из военной в виртуальную информационно-когнитивную область;

– подготовка Соединенных Штатов к конфликту в киберпространстве, основанному на широком применении ТИИ, и контроль информационного пространства облегчают задачу их превосходства над противником. Реальностью становятся автоматизированные, скрытные и высокоточные, масштабные и длительные кибероперации повышенной эффективности на основе интеллектуального кибероружия (например, на основе самореплицирующихся вредоносных компьютерных программ-вирусов и пр.). Одновременно создаются самообучающиеся системы ведения киберобороны на базе ТИИ, способные выявлять аномальное функционирование компьютерных сетей и нейтрализовать киберугрозы;

– возможность скрытного воздействия на ВС противника с использованием интеллектуальных сетей, объединяющих средства разведки и поражения, созданных с применением ТИИ и нанотехнологий;

– использование возможности повышения интеллектуального потенциала и других возможностей личного состава ВС с помощью создания гибридных человеко-машинных систем для получения конкурентного преимущества в рамках глобальной, межгосударственной, межэтнической, религиозной и других конфронтаций;

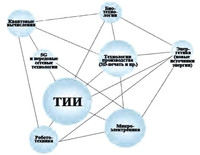

– создание средств вооруженной борьбы на новых физических и технологических принципах с использованием ТИИ в других технологиях, определяющих мировое развитие – нано-, био-, психо-, социально-когнитивные и ядерные технологии, квантовые вычисления, 5G и другие передовые сетевые технологии.

Цель внедрения технологий ИИ в сферу вооруженной борьбы – получение асимметричного преимущества посредством значительного усиления интеллектуального человеческого потенциала за счет автоматизации принятия и выполнения решений (визуализация, планирование, определение приоритета целей и задач, выявление уязвимых и слабых мест и пр.) и масштабного использования автономных РТК (АРТК) военного назначения.

На этом фоне разработка военных ТИИ на сегодняшний день остается в "серой зоне" международного права. Сложную проблему представляет контроль над их экспортом и невозможность контроля программных кодов таких технологий. Становятся реальностью возможность искажения глобального информационного пространства в целом, в том числе процессов моделирования в вычислительных системах, похищения и манипулирования данными в обучающих системах и т. д.

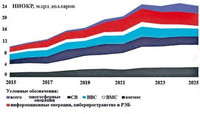

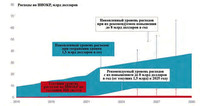

По мнению ряда американских экспертов, большая часть военных разработок на базе ИИ представляет собой "экзистенциальную угрозу существованию человечества". Вместе с тем масштабы деятельности Пентагона в этой области свидетельствуют об увеличении расходов на эти цели начиная с 2015 и по 2030 год.

Вашингтон признает, что неконтролируемое развитие и применение АРТК ВН несут риски непреднамеренной эскалации с возникновением последующей кризисной нестабильности. При этом в ходе дальнейшей роботизации вооруженной борьбы все меньше будет оставаться времени для принятия мер по деэскалации конфликта.

По мнению экспертов образованной в 2019 году комиссии США по национальной безопасности и искусственному интеллекту (National Security Commission on Artificial Intelligence), решение вопросов обеспечения соответствия разрабатываемых и принимаемых на вооружение различными странами АРТК ВН требованиям безопасности и нормам международного гуманитарного права (МГП) должны взять на себя именно Соединенные Штаты.

1. Использование АРТК ВН должно осуществляться под контролем человека-оператора и по указанию командования.

Используемое средство вооруженной борьбы на базе ТИИ должно быть разработано в соответствии с требованиями безопасности и пройти необходимые испытания, обеспечивающие использование данного АРТК ВН согласно нормам международного гуманитарного права.

2. Существующие процедуры МО США должны гарантировать, что ВС имеют на вооружении (оснащении) безопасные и надежные комплексы и обеспечивают их применение согласно МГП.

3. Практически отсутствуют свидетельства о том, что комплексы государств-соперников на базе ТИИ соответствующим образом спроектированы, изготовлены и будут использоваться согласно МГП.

4. Комиссия США по национальной безопасности и искусственному интеллекту выступает против предложения о международном запрете использования АРТК, поскольку это не соответствует американским интересам и требованиям обеспечения международной безопасности.

Эти положения в сфере использования АРТК ВН комиссией США по национальной безопасности и искусственному интеллекту обосновываются следующим образом:

– несмотря на ведущиеся обсуждения в рамках ООН данной проблемы, не выработано четкого определения термина "автономные системы вооружений", что делает невозможным заключение эффективного международного соглашения;

– затруднительно создание эффективного механизма контроля, так как контролирующие лица должны иметь доступ к программному обеспечению систем ВВТ, чтобы убедиться, что у него нет функций автономности.

С этим верификационным режимом вряд ли сможет согласиться какая-либо из сторон – участниц соглашения, как подрывающим уровень их военной безопасности;

– эффект от запрета АРТК ВН нанесет ущерб стратегическим интересам Соединенных Штатов. Более того, международное соглашение несет стратегические риски, подрывая отношения США с союзниками и партнерами в случае, если часть из них присоединится к соглашению, а Вашингтон не присоединится. При этом возникнет проблема обеспечения эффективности взаимодействия роботизированных формирований ВС США в рамках коалиционных (многонациональных) группировок войск (сил) в ходе проведения совместных операций.

Эти положения основаны на нижеперечисленных принципах международного гуманитарного права:

– Принцип различения – стороны военного конфликта должны различать комбатантов от гражданских лиц. Робототехнические комплексы должны иметь средства идентификации целей, снижающие число случаев неправомерного применения оружия, жертв среди гражданского населения и сопутствующий ущерб инфраструктуре.

– Принцип пропорциональности запрещает атаки, которые могут привести к непредвиденным жертвам среди гражданских лиц, чрезмерным по отношению к ожидаемому военному преимуществу. АРТК ВН должны проектироваться и изготавливаться для действий, осуществляемых и направляемых человеком, который оценивает их пропорциональность. Моральная ответственность соотнесения военного преимущества со степенью нанесения вреда гражданским лицам остается за командующим-человеком.

– Принцип ответственности. Обеспечение ответственности командующего является важным для согласованности с МГП. За разработку, производство и причиняющих чрезмерный ущерб или обладающих высокой степенью неизбирательности (конвенция о "негуманном" оружии). испытания17, применение всех робототехнических комплексов должен отвечать человек, независимо от степени реализованности в них ТИИ. Требования к ним те же, что и к системам управления, используемым человеком и обеспечивающим ответственность человека согласно МГП. Это относится ко всем применяемым в ходе военных (боевых) действий системам ВВТ.

МО США создало межвидовую правовую рабочую группу по законам войны, на которую возложена ответственность за разработку и координирование инициатив в этой сфере, анализ правомерности новых средств и способов ведения боевых действий, последствий влияния внедрения новых технологий на МГП.

Международный комитет Красного Креста отметил США среди восьми стран, имеющих механизмы и инструменты оценки легальности систем ВВТ.

В результате комиссия США по национальной безопасности и искусственному интеллекту выступает за несение человеком ответственности за решения о лишении жизни людей посредством применения АРТК ВН в ходе военных конфликтов. Государства обязаны обеспечить необходимую степень вовлеченности человека в принятие решения вне зависимости от ситуации, критичности времени, условий боевых действий, применяемого типа оружия и пр. За результаты применения АРТК ВН должны нести ответственность их операторы.

Таким образом, существуют комплексные и разноплановые угрозы безопасности существования и выживания человечества в условиях ослабления морально-нравственных устоев, обусловленные внедрением технологий искусственного интеллекта в политической, экономической, социальной, нормативно-правовой, военной и других сферах с непредсказуемой динамикой их развития. При этом использование ИИ повлечет за собой не полностью осознанные риски для всего человечества.

Развитие и внедрение технологий ИИ окажет значительное влияние на характер социально-экономической трансформации общества. Корпорации – владельцы цифровых платформ и сервисов на базе ТИИ – во многом определяют направленность и содержание современных потребительских, общественно-политических и социально-культурных тенденций, тогда как формирование универсального международного нормативно-правового режима или хотя бы неких общепринятых правил поведения в сфере таких технологий является в современных условиях весьма затруднительным. Одновременно можно прогнозировать, что повсеместное внедрение технологий ИИ неизбежно приведет к усилению тенденций создания глобально-информационного общества (стирание национальных границ и размывание этнокультурных особенностей) с одновременной деградацией морально-этических норм человечества, международного права и гуманитарных законов войны.

|

Основные риски развития и применения автономных робототехнических комплексов военного назначения и пути их преодоления |

||

| Основные риски | Рекомендации комиссии США по НБ и ИИ | Цель мероприятий |

|

Меры, предпринимаемые США |

||

| Возможность неавторизованного человеком принятия решения системами на основе ТИИ на применение стратегических ядерных систем оружия | Реализация предложения США о том, что только человек может одобрить применение ядерного оружия | Предотвращение непреднамеренного развязывания ядерного конфликта |

| Проблемы верификации мер потенциального международного соглашения по АРТК ВН | Разработка технических средств верификации | Возможность эффективной верификации мер потенциального международного соглашения без раскрытия технологических, конструктивных особенностей и ТТХ |

| Глобальное неконтролируемое распространение АРТК ВН | Финансирование НИОКР по созданию технических средств для предотвращения глобального неконтролируемого распространения АРТК ВН | Разработка и внедрение в АРТК ВН подсистем, затрудняющих их глобальное неконтролируемое распространение |

|

Меры, предпринимаемые США совместно с союзниками |

||

| Неконтролируемое и непредсказуемое поведение небезопасных и ненадежных АРТК ВН | Разработка международных стандартов и практики создания и принятия на вооружение АРТК ВН | Установление международных норм ответственной разработки и применения АРТК ВН* |

|

Меры, предпринимаемые США совместно с РФ и КНР |

||

| Непреднамеренная эскалация конфликта в результате применения АРТК ВН | Обсуждение вопросов влияния АРТК ВН на кризисную стабильность в рамках существующего диалога США с РФ по стратегической безопасности и развитие подобного диалога с КНР | Повысить степень взаимопонимания аспектов применения стратегических систем оружия и разработать меры по укреплению доверия в сфере применения АРТК ВН |

| * Примечания: с учетом руководящих принципов, выработанных группой правительственных экспертов по летальным автономным системам оружия16, а также рекомендаций директивы МО США 2012 года DoDD 3000.09 "Автономность систем оружия", "Этических принципов для систем с ИИ" Пентагона, предложений комиссии США по национальной безопасности и искусственному интеллекту по ответственной разработке и принятию на вооружение АРТК ВН на базе ТИИ. | ||

1 См.: Леонгард Г. Технологии против человека. М.: ACT, 2018. – С. 21–28. О ’Нил К. Убийственные большие данные. Как математика превратилась в оружие массового поражения. М.: ACT, 2018. – С. 266, 267.

2 Впервые угрозы, связанные с использованием информационно-коммуникационных технологий, стали официально рассматривать с окончанием первого десятилетия XXI века (см. доклад Всемирного экономического форума "Глобальные риски-2014"). Согласно составленным рейтингам рисков вызовы, обусловленные развитием в этой сфере (включая киберугрозы критической инфраструктуре), относятся к наиболее опасным.

3 Так, согласно высказываниям К. Шваба, основателя и президента Всемирного экономического Давосского форума, сегодня мир стоит на пороге цифровой технологической революции, которая принесет фундаментальные изменения с размыванием привычных границ между материальным, цифровым и биологическим мирами.

4 Инструментами здесь становятся алгоритмы принятия решений на основе больших объемов данных о человеческом поведении и достижения в машинном обучении, математическое описание культурных шаблонов поведения и рационального индивидуального мышления, системы тотального контроля и слежения за населением, глобальные социальные сети, развертывание сетей датчиков (нано-, микро-, мини-роботов) и пр. Распространение таких технологий сделает их применение доступным как для государственных, так и криминальных и террористических структур.

5 Зарубежные аналитики отмечают, что в современных условиях направленность трансформации миропорядка определяют негосударственные акторы мировой политики, деятельность которых связана с формированием и обработкой информации, развитием и использованием ТИИ, обеспечением информационной безопасности (так называемой нетократии).

6 См.: Brett McGurk. America Should Build an International Coalition Now// The Atlantic. – March 29, 2020.

7 Некоторые страны уже официально признали виртуальные квазигосударства и открыли на своей территории их представительства, фактически предоставив инструмент реального влияния на политические процессы. Первопроходцем в легализации виртуальной империи посредством открытия на своей территории представительства метавселенной стало правительство островного государства Барбадос, которое выдает визы и предоставляет гражданство (пока второе) виртуального образования.

8 См., например: Ли, Кай-Фу. Сверхдержавы ИИ. Китай, Кремниевая долина и новый миропорядок / Кай-Фу Ли; пер. с англ. Н. Константиновой. – М.: Манн, Иванов и Фербер, 2019, 240 с.

9 Подразумевается возможность "слияния" сознания человека (животных, насекомых) с автоматизированными вычислительными системами посредством создания интерфейса "мозг – ЭВМ". Также размывание границ между "живым" интеллектом и искусственным с разработкой биотехнических гибридов с интеграцией органов человека (животных, насекомых) в искусственные системы (например, с использованием зрительных систем и мозга).

10 Повышение физиологических (биологических) характеристик организма на основе манипулирования функциями и возможностями человеческого организма, управления биохимическими процессами, дистанционного управления поведением.

Так, на сегодняшний день уже более миллиона американцев имеют медицинские имплантаты, подсоединенные к глобальной сети Интернет и в основном связанные с кардиоконтролем, а также с контролем уровня сахара в крови. Также увеличивается количество такого рода имплантатов, в значительной мере порожденных достижениями биотехнологий и микроматериаловедения. Есть основания полагать, что в ближайшие 5–7 лет встроенные в человеческое тело имплантаты, соединенные с Интернетом, из экзотики превратятся в обыденность практически во всех развитых странах мира.

11 В последние 10 лет стремительно нарастают процессы своего рода соединения кластера информационных наук и технологий с науками о жизни и биотехнологиями. Уже сформировалась биоинформатика и ее многочисленные практические применения. В целом они получили названия генно-информационной инженерии и производственных биотехнологий и т. п. Наиболее ярким проявлением производственных биотехнологий является индустрия индивидуализированных лекарств, на которые делают ставку фармацевтические гиганты и быстроразвивающиеся в этой сфере компании. Сюда же относятся различные виды регенеративной медицины. Широко используются возможности 3D-печати для производства донорских органов. Сегодня это уже не фантастика, а прошедшая клинические испытания обыденность, которую взяли на вооружение медицинские учреждения США, Франции и Германии.

12 Примерами являются масштабные генетические базы населения: GenBank США, руководимый американским министерством здравоохранения; China National GeneBank КНР, возглавляемый BGI (Beijing Genomics Institute) Group под эгидой Пекинского института генома.

13 Сторонники технофашизма исходят из допущения, что все процессы познания и самосознания, проявления высшей духовной сферы человека можно свести к совокупности вычислительных процессов (обработке данных), то есть к редукции до уровня рационального мышления. Полагают, что разум вполне материален, возникает из физических процессов, ограничен только ими и во всех своих проявлениях "не более чем поведение огромного скопления нервных клеток и связанных с ними молекул". В итоге декларируется, что случайно возникший в ходе эволюции естественный интеллект есть лишь частный случай ИИ.

14 Решение США о создании в рамках "Стратегии национальной безопасности", "Стратегии национальной обороны" и Меморандума заместителя министра обороны 27 июня 2018 года Объединенного центра ИИ МО США (Joint AI Center).

15 Китай. В рамках программы "План научно-технического и инновационного развития" 13-й пятилетки и трехлетнего "Плана развития промышленности на основе ИИ нового поколения" (2018–2020).

Индия. В рамках "Национальной стратегии развития ИИ" и "Дорожной карты развития ИИ для обеспечения обороны и безопасности Индии".

Франция. В рамках объявленного министром ВС резкого увеличении расходов (до 1,83 млрд долларов) на развитие ИИ для создания перспективных систем ВВТ, парламентского "Отчета Виллани" (где утверждается, что "ИИ является центральным политическим принципом обеспечения безопасности и поддержки господства над потенциальными противниками"), "Дорожной карты изучения возможностей ИИ для создания вооружений" и ее первого этапа – проекта "человеко-машинного взаимодействия" (Man-Machine Teaming).

Великобритания. В рамках участия в военных программах США в сфере ТИИ. Решением МО в мае 2018 года учрежден единый исследовательско-внедренческий центр ИИ при лаборатории науки и технологий в области обороны (Defence Science and Technology Laboratory).

Изменится ход процессов принятия решения на стратегическом уровне, содержание оперативно-стратегических концепций боевого применения, параметры тактического маневра и всестороннего обеспечения боевых действий. ТИИ изменят все пространственно-временные параметры войны, такие как темп операций и их масштаб. Подвергнется коренным преобразованиям характер взаимодействия в системе "человек–машина", степень ситуационной осведомленности и адаптивности к быстроменяющейся ситуации.

16 См. Заключительный отчет 2019 года группы правительственных экспертов по новым технологиям в области летальных автономных систем оружия, а также группы правительственных экспертов государств – участников Конвенции по запрету и ограничению применения определенных видов обычного оружия,

17 Директива МО США 2012 года (DoD Directive, DoDD) 3000.09 "Автономность систем оружия" определяет политику в этой области и вводит порядок создания АРТК ВН. Согласно директиве командующие и операторы должны контролировать использование АРТК ВН – авторизовать выбор цели для поражения и обеспечить применение оружия в соответствии с МГП.